Подписка на рассылку

Введите свой адрес электронной почты и подпишитесь на нашу рассылку

Введите свой адрес электронной почты и подпишитесь на нашу рассылку

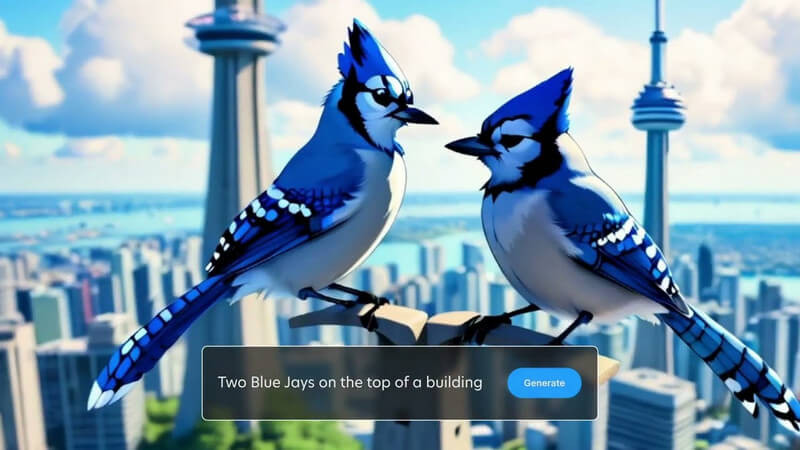

Возможно, вы уже знаете, как создавать изображения, генерируемые искусственным интеллектом, с помощью Stable Diffusion. Теперь вы можете дать этим изображениям новую жизнь с помощью анимированной графики, созданной искусственным интеллектом. Добро пожаловать в Стабильный видео Диффузия который поможет вам превратить статические изображения в динамичные видеоролики. В этом посте я расскажу вам все самое важное о Стабильная генерация диффузионного видео и как вы можете использовать его как профессионал.

Как вы знаете, Stable Diffusion — это модель искусственного интеллекта с открытым исходным кодом, созданная Stability AI. С помощью Stable Diffusion вы можете создавать изображения, просто вводя текстовые подсказки. Теперь, благодаря видеоверсии Stable Diffusion, вы можете бесплатно конвертировать изображения в короткие видеоролики.

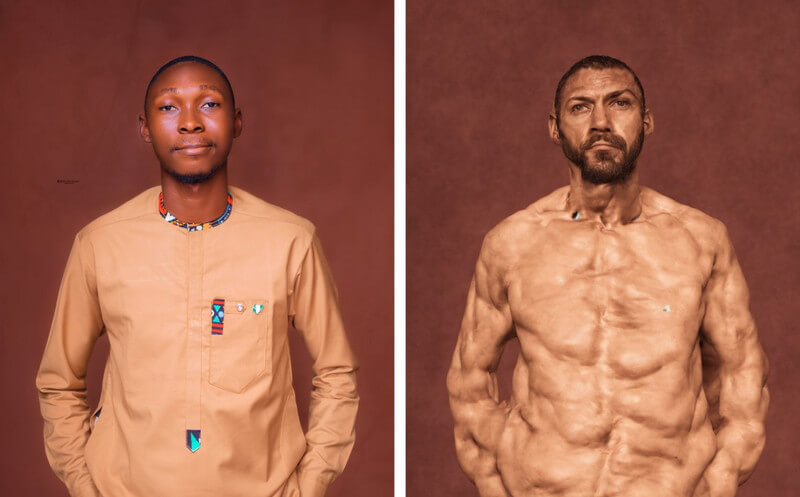

Модель искусственного интеллекта принимает изображение в качестве исходного кадра и создает для него последующие кадры, используя уникальную технику, известную как диффузия. Этот метод идеально добавляет различные детали (будь то фон или объект) к исходному изображению, превращая его в видео. Stability AI обучил модель на основе большого набора реалистичных видео и фотографий, которые можно запускать виртуально или в локальной системе.

Общий, Стабильная диффузия видео — это мощный инструмент, который поможет вам создавать видео любого типа — от творческого до образовательного контента. Хотя она была выпущена недавно, модель все еще находится в разработке и, как ожидается, будет развиваться в будущем.

В настоящее время вы можете использовать функцию видео Stable Diffusion двумя способами: вы можете либо установить ее в своей системе, либо использовать любое веб-приложение.

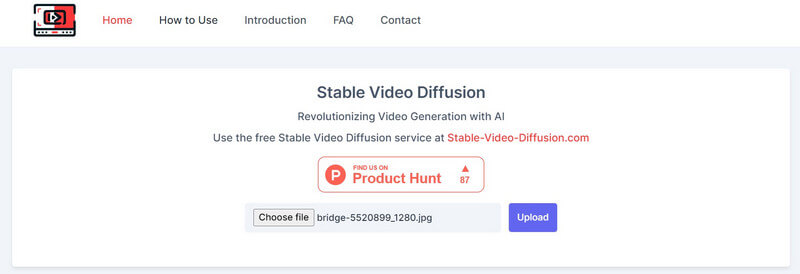

С Stable Diffusion AI видео в видео бесплатно Решение представляет собой предложение с открытым исходным кодом, различные сторонние инструменты интегрировали его на свои платформы. Например, вы можете посетить сайт: https://stable-video-diffusion.com/ и загрузите свою фотографию. Как только фотография будет загружена, инструмент автоматически проанализирует ее и преобразует в видео.

Вот и все! Через несколько секунд онлайн-инструмент сгенерирует короткое видео на основе загруженной фотографии. Вы можете просто просмотреть видео здесь и загрузить его в свою систему.

Если вы хотите получать более персонализированные (и нефильтрованные) результаты, вы также можете рассмотреть возможность установки модуля AI из Стабильное видео Диффузия в вашей системе. Однако вы должны знать, что этот процесс немного технический и потребует значительных вычислительных ресурсов.

Предварительные условия:

Если вы выполнили вышеуказанные требования, вы можете запустить консоль Python в своей системе. Теперь вы можете запускать следующие команды одну за другой, которые создадут, активируют и установят в вашей системе необходимые зависимости для запуска Stable Diffusion.

python3 -m венв венв

источник venv/bin/activate

pip install -r требования.txt

После того как среда запущена в вашей системе, вы можете подготовить входное изображение. Если у вас нет изображения, вы можете использовать стандартный AI Stable Diffusion, чтобы создать его, введя текст.

Чтобы создать видео, вы можете просто перейти по стабильное видео-диффузия направление в вашей системе. Просто введите следующую команду, чтобы создать видео, используя входное изображение:

python3 scripts/dream.py –ckpt_path ckpt/stable-diffusion.ckpt –image_path input_image.png –prompt «текст подсказки» –fps 6 –num_frames 100 –augmentation_level 0,5

Обратите внимание, что в приведенной выше команде вам необходимо сделать следующие вещи:

После ввода подсказки вы можете подождать некоторое время, пока Стабильная генерация диффузионного видео завершает свою обработку. Если процесс более сложный, то стабильной диффузии может потребоваться некоторое время, чтобы получить результаты.

После завершения создания видео оно будет сохранено в папке выход каталог с отметкой времени в качестве имени.

Таким образом, вы можете использовать Stable Diffusion AI видео в видео бесплатно (или фото в видео бесплатно) инструмент для создания видео. Вы можете дополнительно поэкспериментировать с различными подсказками и настройками ввода, чтобы настроить результаты.

Вкратце, стабильная диффузия – это Модель искусственного интеллекта создан Stability AI для создания высококачественного медиаконтента (фото и видео). Это более стабильная версия предыдущих моделей, которая без ошибок генерирует реалистичные изображения.

С другой стороны, Unstable Diffusion — его более творческий и неограниченный аналог. В отличие от Stable Diffusion, который обучался на наборе данных отфильтрованных изображений, Unstable Diffusion использует в качестве набора данных нефильтрованные изображения. Вот почему Unstable Diffusion часто может приводить к ошибкам в результатах и создавать более абстрактные работы, чем реалистичные.

С Стабильная диффузия видео все еще развивается, трудно предсказать его фактическое влияние, но оно может иметь следующее влияние:

Как вы знаете, Stable Diffusion может создавать видео за считанные секунды, что может помочь создателям контента сэкономить время. Вы можете придумать анимацию, добавить спецэффекты или перенести стили видео мгновенно, вместо того, чтобы тратить часы на монтаж.

Ручные усилия, которые мы вкладываем в редактирование видео, могут быть дорогостоящими и отнимать много времени. С другой стороны, Стабильная диффузия видео может помочь вам сократить затраты на редактирование за счет автоматизации большинства задач постобработки.

Теперь с помощью Stable Diffusion авторы могут создавать видеоролики, выходящие за рамки их ограниченного творчества. Например, его можно использовать для создания видеороликов с реалистичными спецэффектами или для анимации неподвижных изображений.

Как я уже говорил выше, Stable Diffusion — это инструмент с открытым исходным кодом, который доступен каждому бесплатно. Это делает его ценным творческим ресурсом для всех, кто хочет создавать видеоролики, независимо от их навыков и бюджета.

Как следует из названия, модель ИИ основана на практике распространения, которая обучает искусственный интеллект создавать реалистичные медиа. В ее основе лежат три основных принципа:

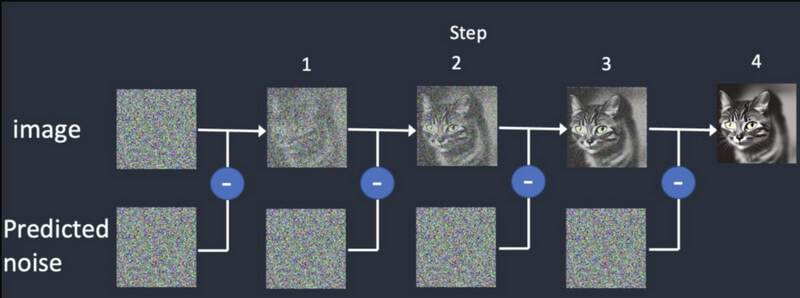

Диффузия: При диффузии мы сначала начинаем со случайного изображения, а затем постепенно добавляем к нему все больше деталей. Он будет продолжать предоставлять разные выходные данные до тех пор, пока не будет соответствовать исходному входному значению. Это позволит тренировать Стабильная генерация диффузионного видео придумать синтетические кадры, на основе исходного.

Обучение: Как и одно изображение, модель диффузии обучается на огромном наборе данных. Таким образом, модель ИИ может легко различать и генерировать всевозможные реалистичные объекты.

Генерация видео: после обучения модели пользователи могут загрузить изображение в модель ИИ. Модель будет уточнять шум для каждого кадра и получать реалистичные результаты на основе предоставленных входных данных для цветов, поворотов, визуальных сдвигов и т. д.

Стабильная диффузия видео выпущен недавно и имеет ряд ограничений, в том числе следующие:

Хорошей новостью является то, что текущая модель искусственного интеллекта Стабильная диффузия видео доступен бесплатно. По данным Stability AI, на данный момент она разработала модель для исследовательских целей. Вы можете получить доступ к коду модели на ее странице GitHub здесь: https://github.com/Stability-AI/generative-models

Кроме того, вы можете получить доступ к документации по Hugging Face здесь: https://huggingface.co/stabilityai/stable-video-diffusion-img2vid-xt

Stability AI сама провела обширное исследование и сравнила свою модель генерации видео с другими инструментами. Согласно исследованию, Stable Video Diffusion сравнивают с такими моделями, как Runway и Pika Labs.

Здесь вы можете увидеть, как эти модели работают при генерации 14 и 25 кадров с настраиваемой частотой 3–30 кадров в секунду. Stable Diffusion также более эффективен по сравнению с Google Video Diffusion и DALL.E, когда дело доходит до создания реалистичных видео.

| Модель | Сила | Слабость |

| Стабильная диффузия видео | Реалистичные и последовательные результаты, хороши для коротких видеороликов из неподвижных изображений. | Ограниченная длина, вариации качества, ограниченный творческий контроль. |

| Распространение видео Google | Может генерировать более длинные видео, хорошо подходит для преобразования текста в видео. | Может выдавать ошибки, требует тонкой настройки (не так стабильно) |

| ДАЛЛ-И 2 | Очень творческий и экспериментальный | Может быть менее стабильным |

| Взлетно-посадочная полоса ML | Простой в использовании и хороший для начинающих | Ограниченные возможности и не такой мощный, как у других моделей. |

| Пика Лабс | Открытый источник | Ограниченная база пользователей, все еще в разработке |

Нет – на данный момент результаты Генерация видео со стабильной диффузией ограничены только 4 секундами. Однако в будущих версиях этого ИИ мы можем ожидать, что он также будет генерировать видеоролики большой продолжительности.

Вот некоторые требования для запуска Стабильная диффузия видео:

| Требование | Минимум | рекомендуемые |

| графический процессор | 6 ГБ видеопамяти | 10 ГБ видеопамяти (или выше) |

| Процессор | 4 ядра | 8 ядер (или выше) |

| БАРАН | 16 ГБ | 32 ГБ (или выше) |

| Хранилище | 10 ГБ | 20 ГБ (или выше) |

Кроме того, вам следует заранее установить Python 3.10 (или выше) в вашей системе.

В настоящее время Stability AI выпустила только Стабильная диффузия видео в исследовательских целях, чтобы модель могла развиваться. Однако в будущем мы можем ожидать, что модель ИИ будет развиваться в следующих функциях:

Я уверен, что прочитав этот пост, вы легко поймете, как Стабильная генерация диффузионного видео работает. Я также придумал несколько быстрых шагов, которые вы можете предпринять, чтобы начать работу. Стабильная диффузия видео самостоятельно. Хотя вы должны помнить, что Модель искусственного интеллекта относительно новый, все еще изучается и может не соответствовать вашим точным требованиям. Продолжайте: попробуйте генеративную видеомодель Stability AI и продолжайте экспериментировать с ней, чтобы раскрыть свои творческие способности!